Vision transformers need registers

Vision transformers need registers

이 포스트는 Academic-reels와 특집 어딘가에 있는... shorts는 아니지만 그렇다고 10분짜리 비디오도 아닌 그런 구성입니다. 정리본 같은 거랄까요되게 Scientific 하게 잘 쓰인 논문입니다. 점수가 매우 높아요. 흥미로운 가설을 설정했고, 가설을 support 하는 좋은 관측들을 했고, 그에 따른 simple-but-effective 한 방법을 제시합니다. 글도 매우 잘 써진 것 같고요.별 5.FAIR, Meta, ICLR 2024 OralObjective and motivation(Our objective) Vision transformer의 마지막 attention layer를 visualize 해보면, 위와 같은 “abnormal patch“ 가 보인다 (semantically..

몽중식: "진짜" 경험팔이 가게

몽중식: "진짜" 경험팔이 가게

경험팔이사실 요즘 동네 주변이나 회사 주변 말고 밥집이든 지나가던 잡화상 (매우 예스럽게 말하자면) 이든, 가게들을 돌아다니다 보면 이게 뭔가 해당 가게의 본질---맛있는 음식, 유용하거나 이쁜 물건들---과는 벗어나서, 그냥 놀이나 경험을 판다는 생각을 하게 만드는 경우가 많다. 뭐 다들 한 번쯤은 생각하겠지만,,, 성수동에서의 실제로 살 물건이 있는건 아니지만 신기해서 들어가 보는 팝업스토어라던지, 귀여운 물건들을 보고 와 굉장히 귀엽다라고 말하고서는 사지 않고 뒤돌아서는 소품샵들이라던지 (이거 정말로 궁금한 건데, 소품샵에서의 실구매율은 얼마나 될지 다른 업종들과 비교해서 측정해보고 싶다). 사실은 피시방에서 끓여 먹는 짜계치가 더 맛있지만 평소에 먹어보지 못한 맛과 멋좀 부리려고 가는 다이닝이나-..

[Reels] Battle of the Backbones: A large-Scale Comparison of pre-trained models across computer vision tasks

[Reels] Battle of the Backbones: A large-Scale Comparison of pre-trained models across computer vision tasks

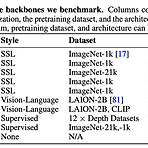

NeurIPS 2023, Arxiv Link What they didThey propose "Battle-of-the-Backones"(BoB), benchmarking a diverse suite of (vision) pre-trained models, including classic ImageNet-trained CNN, vision-language models (perhaps CLIP). The target tasks are OOD-generalization, classification, object-detection and Image retrieval.Key observationswith more than 1,500 training runs, they found that CNN pretrained..

메타분석 시리즈: Loss re-weighting before and after the era of LLMs

메타분석 시리즈: Loss re-weighting before and after the era of LLMs

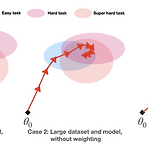

들어가며딥러닝 연구에서, 다양한 문제들이 기존 loss-function에 sample별로 특정 weight를 부과하는 방법 (Loss-reweighting)으로 풀어져 왔었다. 직관적으로 생각했을 때, 이러한 방식은 "어떤 샘플들을 중점적으로 학습시켜야 하는가?"라는 식의 물음이 이어지는 문제를 풀어내는 도구가 될 수 있었다. 따라서 저런 물음이 많이 나오게 되는 Domain-generalization 문제---어떤 데이터 도메인 (e.g. 그림, 사진, 선화, 애니메이션)을 중점적으로 학습시킬까?---, multi-task 문제---여러 task를 동시에 푸는 모델이 어떤 task (depth estimation, object-detction, segmentation)를 중점적으로 학습해야 할 까?,I..

- Total

- Today

- Yesterday

- deeplearning4science

- Theme

- DeepLearning

- vscode

- ICML

- domaingeneralization

- multiheadattention

- Transformer

- flowmatching

- icml2024

- generativemodeling

- loss-weighting

- 프렌밀리

- 몽중식

- MachineLearning

- LLM

- diffusion

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |